Yapay zekâ söyleşi botlarının doğru bilgiye yetişme kabiliyetleri detaylı bir teste doğal tutuldu ve sonuçlar pek de beklediğiniz benzer biçimde değil.

Yapay zekâ söyleşi botları hızla yaygınlaşıyor ve birçoğumuz hayatımın her alanında kullanmaya başladık fakat eğer onları doğru informasyon deposu olarak görüyorsanız ciddi bir hata yapıyor olabilirsiniz.

Yeni bir araştırma yapay zekâ söyleşi botlarının doğru bilgiye yetişme mevzusunda sınıfta kaldığını gözler önüne seriyor.

Araştırma hangi aşamaları içeriyordu?

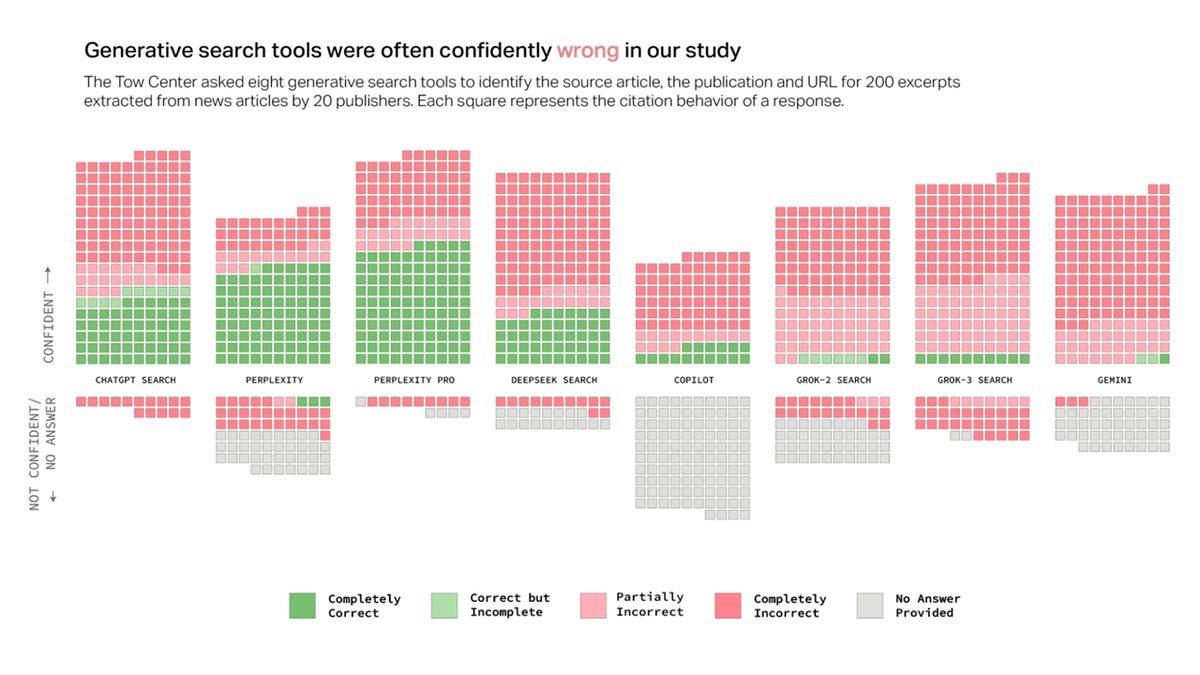

Columbia Journalism Review ve Tow Center for Digital Journalism tarafınca yürütülen araştırma, sekiz yapay zekâ söyleşi botunu gerçek haberler üstünden kontrol etti.

Araştırmacılar, her bir yapay zekâ söyleşi botuna bir haberden alıntı vererek bu alıntının ana kaynağını bulmasını, peşinden başlığını, yayıncısını ve gösterim tarihini paylaşmalarını istedi. Araştırmada kontrol edilen yapay zekâ söyleşi botları şunlardı:

- ChatGPT

- Perplexity

- Perplexity Pro

- DeepSeek

- Microsoft Copilot

- Grok-2

- Grok-3

- Gemini

Sonuçlar ise pek iç açıcı değildi. Bir çok söyleşi botu ya yanlış bilgiler sundu ya da tamamlanmamış yanıtlar verdi. Üstelik, yanıtlarının yanlış olduğu mevzusunda şüpheli bir tavır da sergilemeden doğru yanıtı sunduklarını kati bir üslupla ifade ediyorlardı.

Yapay zekâ söyleşi botları bir tek %40 doğruluğa ulaşabildi

Araştırmanın tamamlanmasıyla beraber yapay zekâ söyleşi botlarına dair bazı çarpıcı bulgulara ulaşıldı.

- Söyleşi botlarının averaj doğruluk oranı %40’ın altında kaldı.

- En iyi neticeleri %63 doğruluk oranıyla Perplexity verdi.

- En fena performansı %6 doğruluk oranıyla Grok-3 sergiledi.

- Ücretli söyleşi botları, parasız versiyonlara kıyasla daha şüpheli yaklaşım sergiledi fakat gene de yanlış yanıtlar verdi.

- Birden fazla söyleşi botu, haber sitelerinin erişim engellerini ihlal etti ve ödeme yapılması ihtiyaç duyulan içeriklere ulaşmanın yolunu buldu.

Peki araştırmadan çıkarılması ihtiyaç duyulan ders ne?

Araştırma, yapay zekâ söyleşi botlarının doğru bilgiye yetişme mevzusunda yetersiz bulunduğunu bir kez daha kanıtladı.

Uzmanlar, bu sistemlerin yalnızca esinlenmek ve düşünce üretmek için kullanılmasını sadece gerçek informasyon arayışında kesinlikle güvenilmemesini öneriyor.

Yapay zekâ ile ilgili öteki içeriklerimiz: