Yapay zeka teknolojisinin son dönemde artan popülaritesi, fena niyetli kişiler tarafınca değişik amaçlarla kullanılabiliyor. Bilhassa sanatçıların sesleri kullanılarak oluşturulan düzmece şarkılar epey popüler. Peki yapay zeka ile klonlanan sesleri, gerçek seslerden ayırt etmenin bir yolu var mı?

Yapay zekanın kullanım alanı giderek genişliyor. Bundan en büyük tesirleri ise siyasal liderler ve dünyaca meşhur kişiler görüyor. Eski ABD Başkanı Donald Trump ve Papa Francis hakkında çıkan yapay zeka kullanılarak oluşturulan görseller toplumda büyük yankı uyandırmıştı.

Düzmece seslerle üretilen şarkılar ve videolar her ne kadar keyifli gözükse de işin bir de karanlık bir boyutu var: Dolandırıcılık. Geçtiğimiz dönemde bir anneden kaçırılan kızı için fidye istenmiş ve durumun gerçekliğini kanıtlamak için kaçırmış olduğu söylenen kızın düzmece sesi kullanılmıştı. Aslına bakarsak kız asla kaçırılmamıştı.

Aynı dolandırıcılık yöntemi, yapay zeka ile daha gerçekçi bir hal alıyor

Yapay zeka dolandırıcılığı giderek yaygınlaşıyor ve telefonun ucundaki ses, sevdiğiniz bir insanoğlunun sesi şeklinde geldiği için bu durum epey ürkütücü bir hal alabiliyor. Günümüzde ülkemiz dahil dünyanın birçok yerinde dolandırıcılık bazıları için artık bir meslek. Değişen teknolojinin de gelişmesiyle bu durum giderek inandırıcılığını artırıyor. Telefonda meydana getirilen dolandırıcılıklar, doğal olarak ki en kolayı ve en yaygını. Fakat artık daha ürkütücü.

2023’ün Nisan ayında, yeni nesil yapay zeka dolandırıcılıklarının örneklerini görmüştük. Mesela davet yanıltma yöntemi kullanılarak sevilen biri, kurbanın telefonunda arayan şahıs olarak görünmüştü. Bir diğeri ise, kaçırılmamış olan kızını özgür bırakmak için bir anneden fidye parası koparmaya çalışmak amacıyla bir yapay zeka ses klonunu kullanmıştı.

McAfee şirketi, yapay zekanın bu tür fena kullanımını görmüş oldu ve mevzuyla ilgili derinlemesine bir rapor yayınladı. Şirket yayınladığı raporda, düzmece sesleri önlemenin ve dolandırıcılıktan korunmanın yollarını açıkladı.

Şekilleri açıklamadan ilkin gelin beraber yapay zeka düzmece seslerinin iyi mi çalıştığına bir bakalım.

Yapay zeka ses klonlama iyi mi çalışır?

Ilk olarak yapay zeka ses dolandırıcılığının uzun süreden beri mevcud bir yöntemin yeni versiyonu bulunduğunu sadece ondan oldukça daha ikna edici bulunduğunu söyleyebiliriz. Çoğu zaman bu biçim bir dolandırıcılıkta; sevilen birinin sesi kullanılarak acil bir durum için para isteniyor yada kurbana, sevilmiş olduğu birini fidye için kaçırdıkları söyleniyor.

2019 senesinde, İngiltere merkezli bir enerji şirketi CEO’sunun kimliğine bürünen dolandırıcılar, 243.000 dolar talep etti. Hong Kong’da bir banka müdürü, ses klonlama teknolojisini kullanan biri tarafınca kandırılarak 2020’nin başlarında yüklü oranda havale yapılmasını sağlamış oldu. Kanada’da ise minimum sekiz yaşlı yurttaş, bu senenin başlarında ses klonlama dolandırıcılığıyla toplam 200.000 dolar yitirdi.

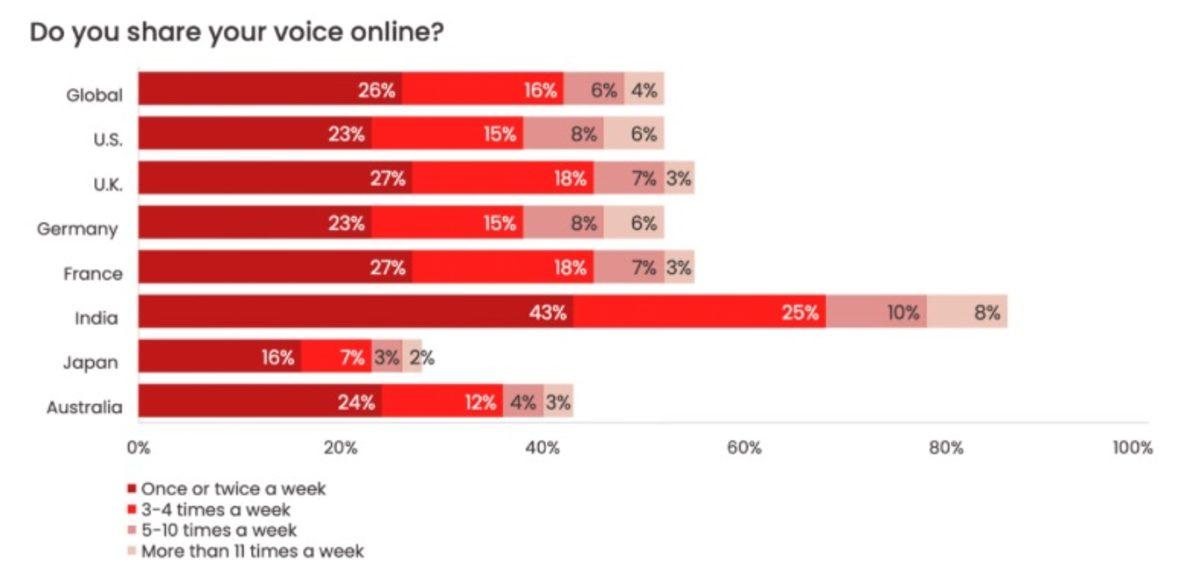

Yapay zeka ses klonlama araçları oldukça ucuz ve kullanılabilir olduğundan, fena niyetli taraflar için ses klonları oluşturmak da aslına bakarsak oldukça rahat. Bunu yapmak için örnek ses elde etmenin en kolay yolu da doğal olarak ki toplumsal medya. Sesinizi çevrimiçi olarak ne kadar oldukça paylaşırsanız, dolandırıcıların sesinizi bulması ve klonlaması da o denli kolay oluyor.

Yukarıdaki görselde, meydana getirilen bir anketin neticelerini görebilirsiniz. Elde edilmiş verilere nazaran; kullananların %26’sı haftada bir ya da iki kere seslerini toplumsal medyada paylaştığını söylüyor.

Yapay zeka ses dolandırıcılığı ne kadar yaygın?

Haberlerde yapay zeka ses dolandırıcılığı ile ilgili bazı hikayeler yeni yeni görünmeye başlasa da, meydana getirilen araştırma bu biçim dolandırıcılıkların oldukça yaygın hale geldiğini ortaya koyuyor.

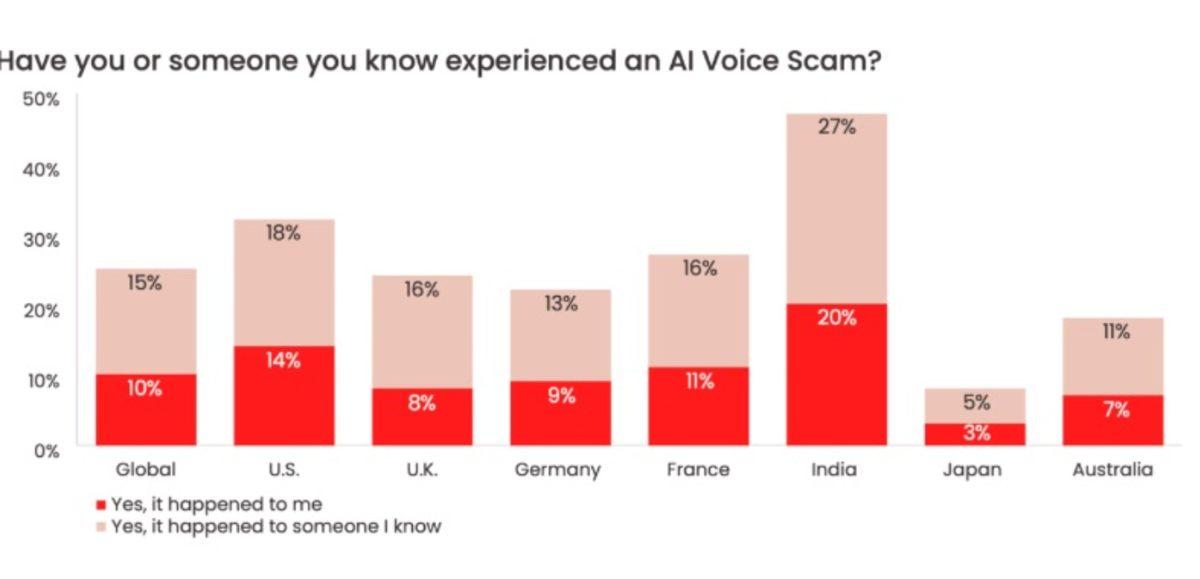

Küresel anketlere bakıldığında, kişilerin %25’i ya kendisinin ya da tanımış olduğu birinin yapay zeka dolandırıcılığına maruz kaldığını söylüyor. Anket verilerine nazaran yapay zeka ses dolandırıcılığı mevzusunda en fazla problem yaşayan ülke %47 ile Hindistan.

Ses klon araçları, %95 oranında doğruluk sağlıyor

Ses klonlama için kullanılan yapay zeka araçları o denli gerçekçi ki mağdurların neredeyse tamamı düzmece sesin, tanıdıkları kişinin sesine tıpatıp benzediğini söylüyor. Hatta yukarda bahsettiğimiz fidye vakasında mağdur anne, kızının sesi haricinde “tonlamasının” bile aynı bulunduğunu ifade ediyor.

Yapay zeka düzmece seslerinin gerçeğine bu kadar benzemesi, insanlara kısacık bir vakit diliminde binlerce dolar kaybettiriyor. Araştırmaya nazaran yapay zeka ses dolandırıcılığı kurbanlarının %77‘si paralarını kaptırıyor. Veriler, 2022 yılı genelinde toplamda 2,6 milyar dolarlık bir paranın bu yöntemle çalındığını gösteriyor.

Peki, düzmece sesler gerçeğinden iyi mi ayırt edilir?

Yapay zeka ses dolandırıcılıklarını önlemenin şimdilik kati ve süratli bir yolu yok. Sadece kendi kendinize alabileceğiniz bazı önlemler bulunuyor.

- Sesinizi ve/yada videonuzu çevrimiçi olarak ne kadar paylaştığınızı sınırlayın ve/yada toplumsal medya hesaplarınızı her insana açık yerine hususi olarak ayarlayın,

- Şüpheli bir davet alırsanız ve sevdiğiniz biri sizden acil olarak maddi bir yardım isterse yalnızca o kişinin yanıtlayabileceği bir yada iki soru problem (cevabı internette olan bir soru asla sormayın),

- Siber suçlular, mağduru harekete geçirmek için yansılamak ettikleri kişiyle aranızdaki duygusal bağa güvenirler. Şüpheci olun ve sorgulamaktan çekinmeyin. Şüpheleriniz geçmediyse telefonu kapatın ve kendiniz o kişiyi direkt olarak arayın.