Google, Gemini mimarisi üstüne geliştirilen yeni multimodal embedding modeli Gemini Embedding 2’yi tanıttı.

Google, Gemini mimarisi üstüne geliştirilen ilk tam multimodal embedding modeli olan Gemini Embedding 2’yi tanıttı.

Yeni model, geliştiricilerin kullanımına Gemini API ve Vertex AI üstünden ön seyretme olarak sunulmuş durumda.

Metin, görüntü, video ve ses tek bir sistemle çözümleme edilebilecek

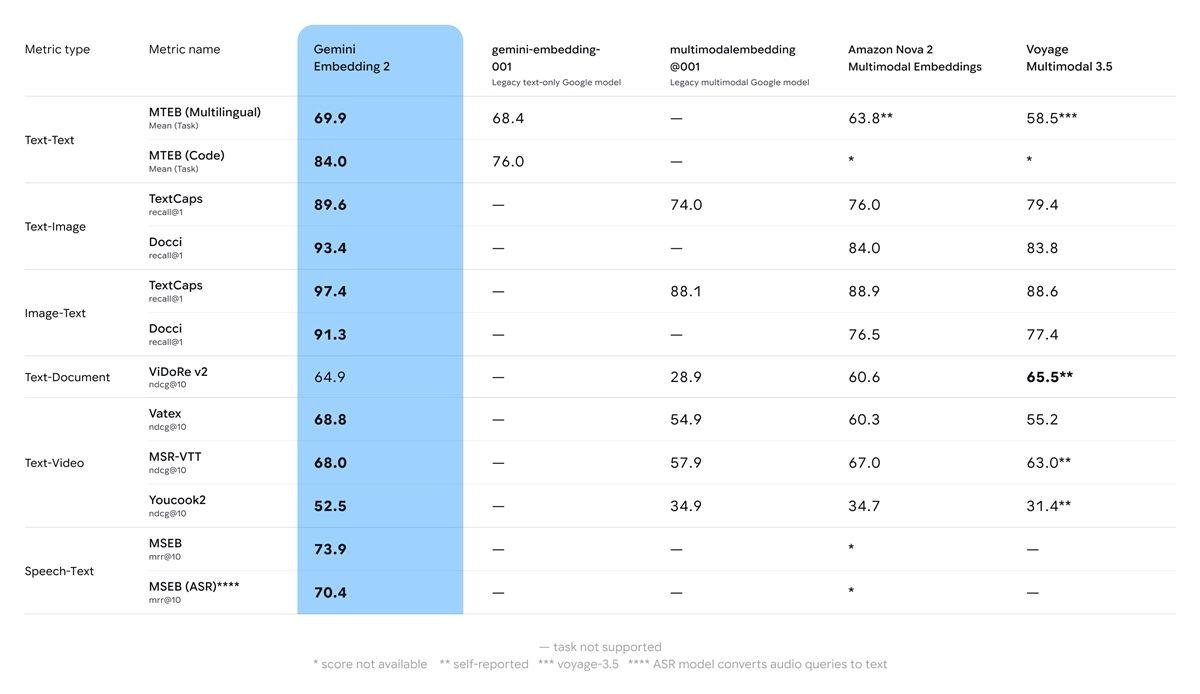

Gemini Embedding 2’nin en dikkat çekici özelliği, değişik veri türlerini tek bir ortak anlam uzayında işleyebilmesi. Model; metin, görüntü, video, ses ve belgeleri aynı sistem içinde çözümleme ederek 100’den fazla dilde anlam ilişkilerini ortaya çıkarabiliyor.

Bu sayede geliştiriciler için karmaşık yapay zekâ sistemleri oluşturmak fazlaca daha kolay hâle geliyor. Bilhassa semantik arama, duygu analizi, veri kümelendirme ve RAG (Retrieval-Augmented Generation) benzer biçimde alanlarda daha kuvvetli sonuçlar elde edilmesi hedefleniyor.

Çoklu veri girişi aynı anda kullanılabiliyor

Yeni model değişik veri türlerini tek tek işlemekle sınırı olan değil. Mesela bir görüntü ve metin aynı anda modele gönderilebiliyor. Böylece model, gerçek dünyadaki karmaşık veri ilişkilerini daha doğru şekilde anlayabiliyor.

Gemini Embedding 2’nin teknik kapasitesinden bazı öne çıkan detaylar şu şekilde:

- Metin: 8192 token’a kadar bağlam desteği

- Görüntü: Aynı istekte 6 tane PNG yada JPEG

- Video: 120 saniyeye kadar MP4 yada MOV

- Ses: Transkripsiyon gerektirmeden direkt çözümleme

- Belge: 6 sayfaya kadar PDF

Google ürünlerinde de kullanılacak

Embedding teknolojileri Google’ın pek fazlaca ürününün temelini oluşturuyor.

Şirket, erken erişim ortaklarının Gemini Embedding 2 ile büyük veri analizi, gelişmiş arama sistemleri ve çoklu veri tabanlı yapay zekâ uygulamaları geliştirmeye başladığını belirtiyor.

Peki siz Gemini Embedding 2 hakkında ne düşünüyorsunuz? Düşüncelerinizi aşağıdaki yorumlar kısmından bizimle paylaşabilirsiniz.