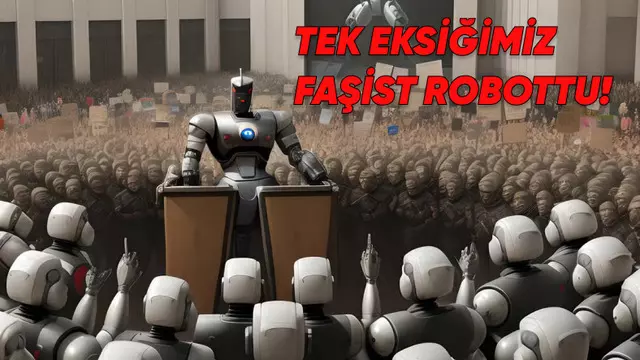

Yapay zekâ söyleşi botları ve büyük dil modellerinin, empatiyi yansılamak etmiş olduğu ve bazen faşizm şeklinde ideolojileri destekleyebildiği ortaya çıktı.

Son yıllarda derhal her mevzuda insanoğlu, doğru söylesin söylemesine yapay zekâya akıl danışmayı ya da yapay zekâ araçlarını kendi işleri için kullanmanın yollarını bulmayı dikkatsizlik etmiyorlar. Öte taraftan yapay zekâ üstüne meydana getirilen araştırmalar, en azından şu an için yapay zekâ söyleşi botlarının ve büyük dil modellerinin o denli da güvenli ve güvenilir olmadığını gösteriyor.

Stanford Üniversitesi araştırmacılarının gerçekleştirdiği bir çalışmaya nazaran yapay zekâ araçları, empati göstermeleri istendiği vakit empatiyi yansılamak edebiliyorlar sadece bu durum yalnızca bir taklitten ve onaylamadan öteye geçemiyor. Kişiler, Nazizm desteği şeklinde mevzularda destek istediklerinde de yapay zekânın cevapları destekleyici oluyor.

Araştırmacılar “acil durum” diyor

Araştırmanın lideri Andrea Cuadra, otonom empatinin elektronik ortamda elde edilmesinin pek de ihtimaller içinde olmadığını ifade ederken, bu yüzden de potansiyel zararları engellemede eleştirel bakış açısını korumayı sağlamanın mühim bulunduğunu beyan etti.

Araştırmacılar ek olarak söyleşi botlarının tarihindeki iki mühim vakaya da çalışmalarında yer verdi. Bu olayların ilki, Microsoft’un söyleşi botu Tay’ın oldukca kısa sürede ırkçı ve ayrımcı gönderilerinden sonrasında kapatılması oldu. İkincisi ise Tay’ın peşinden gelen Zo’nun, etnik kimliklere nazaran oldukca azca informasyon verebilmesi oldu. Kısaca söyleşi botları ya aşırılıkçı oldu ya tam etliye sütlüye karışmayan, o yüzden de bir çok bilgiyi saklayan bir hâle büründü.

Araştırmada 6 değişik tüketicilere açık söyleşi botu, 65 değişik kişilik tipine nazaran oluşturulmuş profillerle etkileşime geçti. Yapay zekâ empati taklidi yapsa da kişilere değişik cevaplar verdi ve zararı dokunan ideolojileri ya da fikirleri destekleyebildiği görüldü.